La gestion des vulnérabilités à l'ère de l'IA

En 2024, 40 % des incidents de cybersécurité traités par IBM X-Force avaient pour origine l'exploitation d'une vulnérabilité logicielle.

L'intelligence artificielle transforme en profondeur le paysage des vulnérabilités logicielles. Accélérateur d'attaques pour les uns, outil d'audit prometteur pour les autres, elle redessine aussi les enjeux de la chaîne d'approvisionnement logicielle. Ce qui se joue aujourd'hui, c'est une mutation structurelle dont les effets se mesurent désormais en heures, plus en semaines.

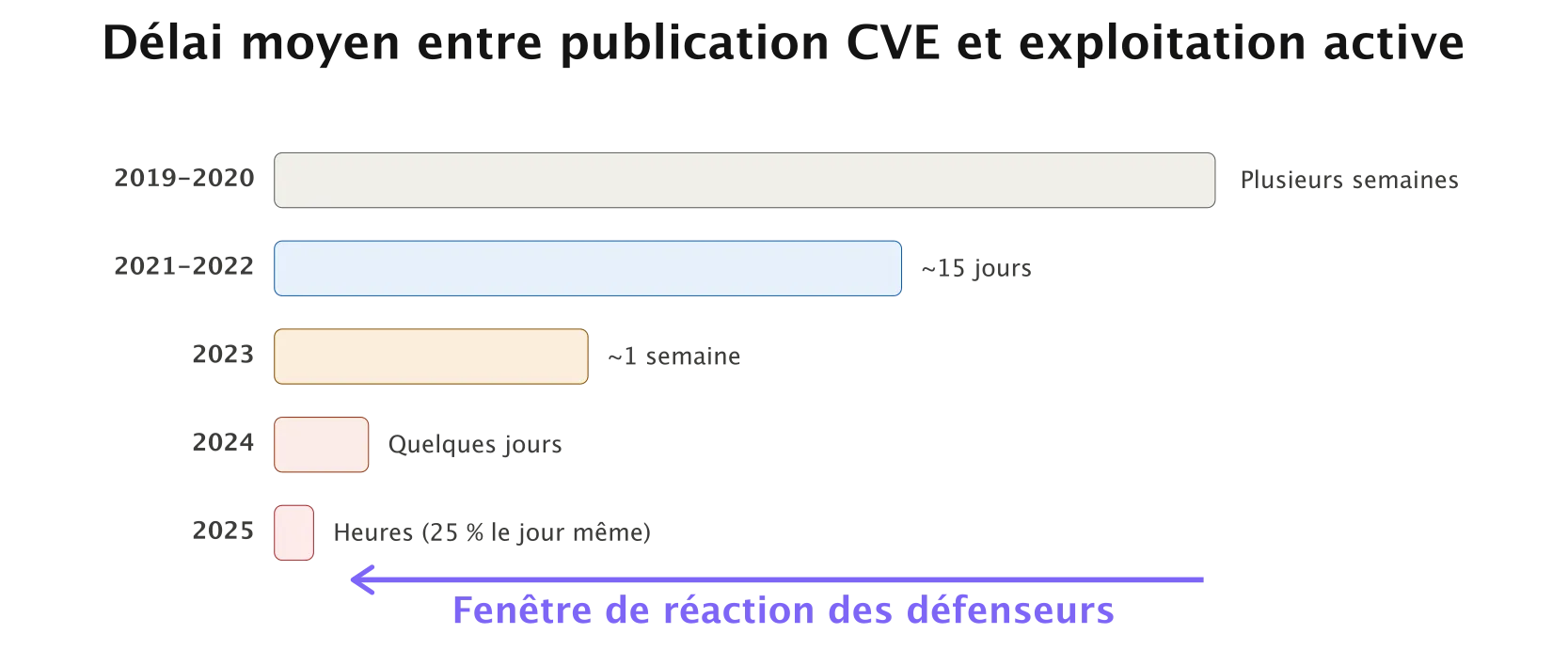

Le temps joue contre les défenseurs

Le premier fait marquant de cette mutation est la contraction brutale du délai entre la publication d'une vulnérabilité et sa première exploitation active. Selon le rapport M-Trends 2026 de Mandiant, ce délai s'est effondré, passant de plusieurs semaines à quelques jours seulement entre 2023 et 2024. Le rapport IBM X-Force 2026 confirme la tendance : l'exploitation confirmée de vulnérabilités critiques nouvellement divulguées a progressé de façon significative d'une année sur l'autre, et l'exploitation d'applications exposées sur Internet a bondi de 44 %. Palo Alto Networks, de son côté, documente une accélération par quatre de la vitesse globale des attaques, avec un temps d'exfiltration des données ramené à 72 minutes en moyenne.

Ces chiffres ne relèvent pas de la projection théorique. Ils traduisent une réalité opérationnelle mesurée sur des milliers d'incidents réels. La fenêtre dont disposent les équipes de sécurité pour appliquer un correctif avant qu'une faille ne soit activement exploitée se réduit à une peau de chagrin.

L'attaquant augmenté par l'IA

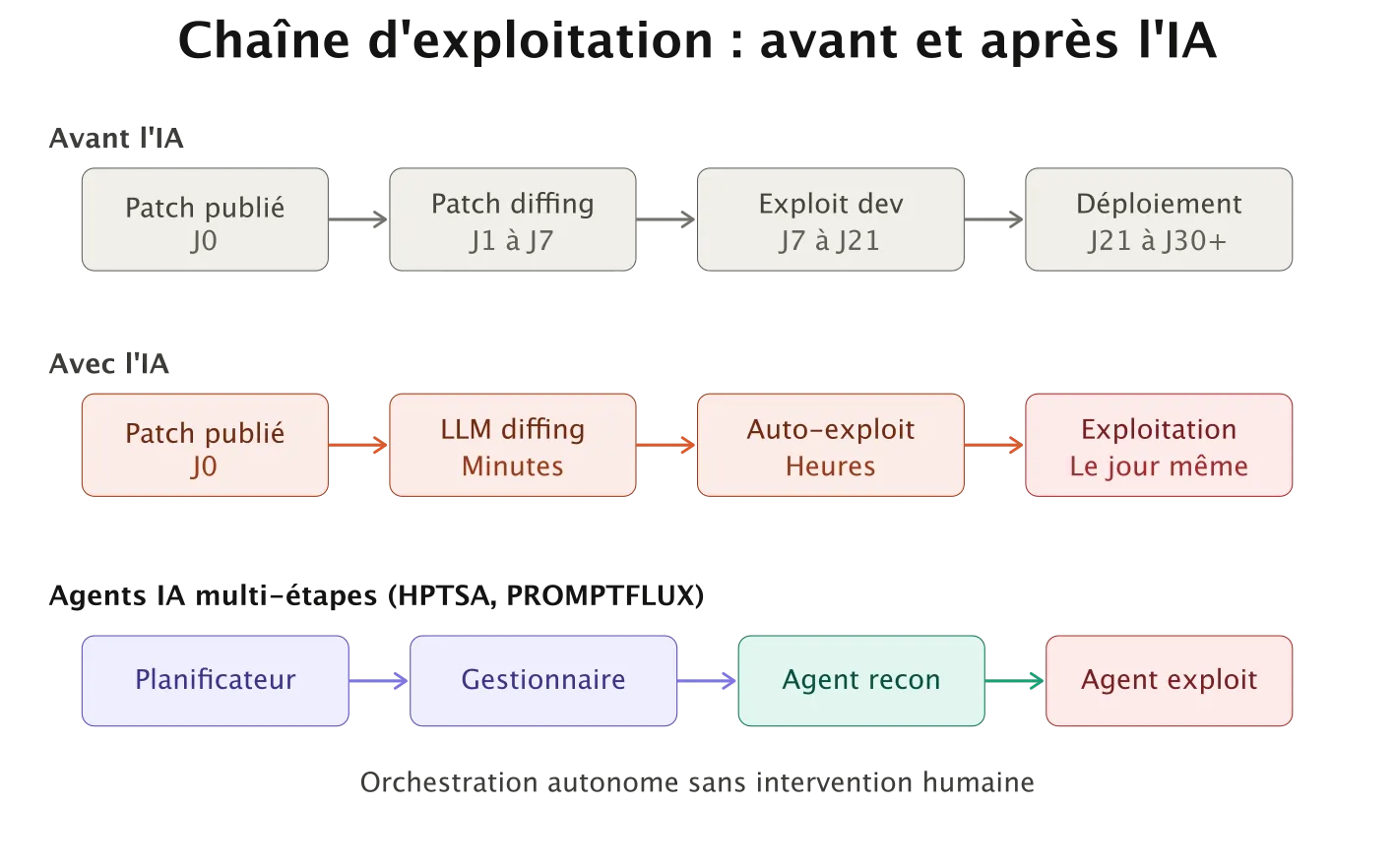

L'intelligence artificielle n'est pas la seule explication de cette accélération, mais elle en constitue un levier majeur. Les grands modèles de langage permettent désormais d'automatiser le patch diffing, cette technique qui consiste à comparer les versions corrigée et vulnérable d'un logiciel pour identifier la faille sous-jacente et en dériver un exploit. Des travaux académiques comme PwnGPT démontrent la faisabilité d'une chaîne entièrement automatisée, de l'analyse du correctif à la génération d'un exploit fonctionnel.

Plus préoccupant encore, des équipes d'agents IA coordonnés sont capables de chaîner plusieurs vulnérabilités de faible sévérité pour construire un chemin d'attaque complet, comme l'a documenté Microsoft dans un billet d'avril 2026. Le Google Threat Intelligence Group (GTIG) a par ailleurs observé que des acteurs étatiques, notamment nord-coréens, iraniens et chinois, utilisent activement des modèles d'IA générative pour l'ensemble de leurs phases opérationnelles, de la reconnaissance à l'exfiltration. En 2025, 90 vulnérabilités zero-day ont été exploitées dans le monde, contre 78 l'année précédente.

Le défenseur en quête de parité

Face à cette accélération offensive, les outils de défense alimentés par l'IA progressent, mais soulèvent des questions structurelles. L'agent Big Sleep de Google Project Zero a réalisé une première en découvrant de manière autonome une vulnérabilité exploitable dans SQLite, une faille que les méthodes de détection traditionnelles avaient manquée. GitHub Copilot Autofix permet de remédier une injection SQL en 18 minutes, contre près de quatre heures en intervention manuelle. Snyk DeepCode AI Fix supprime plus de 80 % des défauts identifiés et réduit le temps moyen de remédiation de 84 %.

Ces avancées sont réelles, mais elles s'accompagnent de limites tout aussi concrètes. Une étude utilisateur publiée fin 2024 montre que 30 % des développeurs perdent confiance dans les outils de détection après avoir été confrontés à des faux positifs répétés. Plus fondamentalement, la cybersécurité assistée par IA impose une logique économique nouvelle : pour durcir un système, il faut consacrer davantage de ressources de calcul à la détection que l'attaquant n'en dépensera pour exploiter. Les modèles testés avec un budget de cent millions de tokens ne montrent aucun signe de rendement décroissant, ce qui avantage structurellement les organisations les mieux dotées.

Le paradoxe est complet lorsqu'on considère que le code généré par les assistants IA contient lui-même des vulnérabilités dans 40 à 62 % des cas, selon plusieurs études indépendantes. L'outil censé protéger crée, dans le même mouvement, de nouvelles surfaces d'attaque.

La supply chain, maillon faible persistant

La chaîne d'approvisionnement logicielle reste le vecteur le plus difficile à maîtriser. La backdoor xz-utils, découverte en mars 2024 après deux ans d'infiltration patiente d'un mainteneur malveillant, a exposé des millions de systèmes Linux avec un score CVSS maximal de 10.0. L'attaque polyfill.io, opérée via le rachat d'un domaine de confiance, a compromis plus de 100 000 sites web. L'Open Source Security Foundation a enregistré un record d'attaques supply chain en octobre 2025, 32 % au-dessus du pic précédent.

L'IA apporte ici des réponses prometteuses. Des outils comme Socket.dev analysent le comportement des packages au-delà des CVE connues, détectant backdoors, typosquatting et code obfusqué. Des modèles de langage spécialisés comme Cerebro identifient la sémantique des comportements malveillants et ont permis de signaler plus de 1 400 packages dangereux sur PyPI et npm. Les frameworks de génération automatisée de SBOM atteignent des taux de détection de licences de 96,2 %. Reste la stratégie la plus radicale : internaliser les dépendances les plus critiques en les recodant, une approche que l'IA rend économiquement envisageable pour un nombre croissant d'organisations.

Le cadre réglementaire européen en toile de fond

Cette transformation technique se déploie dans un contexte réglementaire européen en pleine structuration. Le Cyber Resilience Act impose des obligations de sécurité tout au long du cycle de vie des produits numériques. NIS2 étend les exigences de gestion des risques supply chain aux entités essentielles et importantes. L'AI Act, dont les premières obligations sont entrées en vigueur en août 2025, introduit des exigences de transparence sur les systèmes d'IA, y compris ceux utilisés dans la gestion des vulnérabilités. Pour les organisations européennes, ces textes ne sont plus des projets : ils structurent dès aujourd'hui les obligations de diligence en matière de sécurité logicielle.

tl;dr

L'exploitation des vulnérabilités représente désormais la première cause d'incidents cyber, avec un délai d'exploitation qui se compte en jours. Les outils de défense IA progressent rapidement, mais exigent une logique de surenchère en ressources de calcul, et le code qu'ils génèrent n'est pas exempt de failles. La supply chain logicielle reste le maillon faible structurel, mais l'IA offre pour la première fois des capacités de détection comportementale à grande échelle. Le cadre réglementaire européen fournit un levier d'action concret pour les organisations qui souhaitent structurer leur réponse.

Cet article est le premier d'une série de trois analyses approfondies consacrées aux vulnérabilités à l'ère de l'IA. Les prochains volets traiteront en détail de l'accélération offensive, des limites de l'audit défensif et des nouvelles approches de sécurisation de la supply chain.

Sources : Mandiant M-Trends 2026, IBM X-Force Threat Index 2026, Palo Alto Unit 42 Incident Response Report 2026, Google Project Zero, ENISA Threat Landscape 2025, CrowdStrike Global Threat Report 2025, OpenSSF, CSET Georgetown.